Liveセットを拝見:Jinku “Barda”

古くから音楽の多様性と実験の中心地であり、世界的な影響と地域の伝統が出会う場所、ナイロビ。 そうした出会いが生み出す新鮮なエネルギーが、現代アフリカ音楽の境界を押し広げるEA Waveのようなアーティスト集団を刺激しています。

JinkuことJacob Solomanは、ナイロビの刺激的なアートシーンに囲まれて育ちました。 EA Waveの創設者であるJinkuは、アフロ・ハウス、R&B、アフリカンパーカッションを融合させたものを“トライバル・ダウンテンポ”と命名。このジャンルを着実に洗練させてきました。

今月、新曲“Barda”をXLR8R+で発表しているJinku。 そこで今回は、現在ストックホルムを拠点に活動するJinkuに、制作の進め方や手法について話を聞きました。 さらに、同曲のLiveセットも提供してくれているので、ダウンロードしてJinkuの制作工程を実際にチェックしてみましょう。

Jinkuの新曲“Barda”で使ったLiveセットをダウンロードする*

*利用するには、Live 11 Suiteのライセンス、もしくは無償体験版が必要になります。

【注意】本Liveセットおよび収録サンプルは教育利用のみを目的としており、商業目的での利用は一切認められておりません。

制作について話してもらう時間をいただき、ありがとうございます。 ナイロビで育ちながら、どのようにして音楽制作の道に入ったんでしょうか?

もともとは、画家かグラフィックデザイナーになりたかったんです。 でも、両親は「医者かエンジニアか会社員になれ」と 反対しましたね。 アーティストがこの国でもっとも貧しい人たちだっていうことを両親は心配していましたし、 当時のナイロビには文化的な面で、みんなのお手本となるものはありませんでした。 それにアーティストとして成功して有名になる人なんてまったくいませんでしたね。 そういうこともあって、僕はコミュニケーションの学位を取ることにしました。 大学時代は、まだPhotoshopとIllustratorを学べたんです。 そのうち、音楽プロデューサーのアートワークを手がけるようになりました。 なので実際は、グラフィックデザインをつうじて音楽の世界に入ったんです。

どのようなことがきっかけで、グラフィックデザインから音楽の世界に入ったんでしょうか?

一緒に仕事をしていたミュージシャンにSaint Evo(英語)という人がいて、アフロ・ハウスとかそういうのを作っていたんです。 それで彼の制作過程を見ているうちに、僕も少しずつアイデアを出し始めるようになって。 そうしているうちにLiveをもらって試してみたら、アフリカ音楽やアフリカのリズムに対する意識全体が変わりましたね。 そこからEA Waveを立ち上げたんですが、以来、こういう別路線の音をナイロビで作り出そうと、ひたすら努力し続けてきました。

Jinkuが参加した人気楽曲。

EA WAVEでは現在も楽曲を発表しているんですか?

EA WAVEが有名になるにつれて、メンバーと一緒に活動して音楽を発表しなければならないというプレッシャーがありました。 でも、最近はアベンジャーズみたいになってきましたね(笑)。 ハルクやアイアンマン、キャプテン・アメリカといったように、それぞれの役割を果たしていますが、あとになって一緒に活動しています。 いまのEA WAVEは、そんな感じですね。 いわば、みんながそれぞれで冒険している感じというか。 でも、タイミングさえ合えば、みんなで何かを発表することになると思います。

EA WAVEのメンバーとは、どうやって知り合ったんですか?

ナイロビでは、新鮮な音に出会いたければ、SoundCloudで探します。 実際、そこでみんなと知り合ったんですよ。 僕らはSoundCloud世代って言われていたかな。 実世界で会ったとき、誰もお互いの本名を知らなかったから、 ユーザーネームで呼びあっていましたね。

最近のナイロビの音楽シーンはどうですか?

やっぱりコロナ禍の影響は大きかったですね。 でも、2019年にSpotifyがケニアに進出してきたり、少しずつですが変わってきました。 たとえば、Spotifyでは地元のアーティストの曲を集めたプレイリストが公開されているんですけど、 それは急成長しているシーンや、僕のあとに続く若手たちの活動を後押しするのに役立っています。

それに僕が音楽制作を始めたころと比べると、最近のナイロビは、表現力が豊かな人が増えてきた気がします。 それにいまのナイロビではクィア・シーンも盛り上がっています。 とくにBakhitaというシンガーは、本当にコミュニティのためにがんばっていますし、 そうやって盛り上がっていて、本当にうれしいです。

自分のことを、さまざまな影響を吸収するスポンジに例えていますよね。 どんな音楽の影響を受けているんでしょうか?

最近は、90年代のヒップホップとか2000年代のR&Bにハマってます。 初めてアフロ・ハウスを聞いたときは、アフリカの打楽器が西洋の音楽で使われていることにびっくりしましたね。 いまはどうやったら、アフロ・ハウスの打楽器をR&Bとかヒップホップにハメることができるかの実験中です。 僕はそういうものを“トライバル・ダウンテンポ”と名付けました。

Jinku『WAVE TAPES 01』

今回提供してくれた曲のLiveセットでは、そういう打楽器に関する影響がたくさん出ていますね。 どうして、この曲を“Barda”という名前にしたんでしょうか?

ダウンテンポが有機的な盛り上がりを見せていて、実はそのなかにBardaっていうミュージシャンがいます。 この曲を作っているときは、Bardaの声と、それがどうやったら引き立つのかを考えていました。 実際は別の名前を考えていたんですけど、“Barda”がしっくりきたんです。

音楽制作を始めるときは、まず楽器を弾くところから始めるんでしょうか? それともすぐにLiveを立ち上げますか?

最近は、何かフレーズを思いついたら、携帯電話で録音して、それをLiveに取り込むことが多いですね。 それから、タップテンポ機能を使って、取り込んだフレーズのテンポに合わせます。新曲の多くでBPMが91.83とか80.47って変なテンポになっているのは、自分の体内リズムを使ってテンポを決めているからです。

スタジオでは普段どんな感じで制作しているんでしょうか?

2工程あります。 作曲工程とミキシング工程です。 作曲工程では、とにかく壁に向かってあらゆるものを投げつけてみるというか。 そのときに使えそうな音を探したり、曲の基本となるグルーヴを考えたりしながら、いろいろな組み合わせを試していきます。 それを飽きるまでやったら、一旦、制作を終了します。 その制作を再開するときになったら、全部をタイムラインへ放り込みます。 いろいろなものをソロにして、どの組み合わせがうまくいくかとか、別のパートとの関係が生まれているかを確認します。 それからミュートボタン(キーボードの数字キー[0])でクリップを無効にして曲を組み立てる作業に移ります。 アレンジができたら、ミックス作業に取りかかります。 個人的には、このミックス作業の段階がとても楽しいんですよ。曲を成り立たせる作業ですからね。

音は粘土のかたまりで、EQは彫刻家なんです。

“Barda”のLiveセットでは、全トラックがオーディオとして書き出されています。 これは、制作上での判断でしたか?

そうやって作業してるってだけですよ。 僕はいつも全部をオーディオにバウンスします。 MIDIはなんだか好きになれなくて。 オーディオで書き出した方が、取り組んでる感じがするんですよね。 あと、プラグインのことを気にせずに、いろんなコンピュータに自分のLiveセットを移せるようにしたいんです。 サイズの大きな音源ライブラリを移すのって、いつも手間だし。 なので、アイデアをかたちにできたら、それをすぐにフリーズしてオーディオにしています。 これは、かなり意識的にやっていることですね。

多くのチャンネルで、たくさんのEQを直列に並べて使用していますね。 これはどんな意図なんでしょうか?

音は粘土のかたまりで、EQは彫刻家なんです。僕はそう考えていますね。 ひとつのEQで多くのノッチを作るべきじゃないっていうのを複数のフォーラムで読みました。 それだと、引き算をするっていうより、壊すことになるって書いてました。 だから、複数の違うEQで細かくやるほうがいいんです。そのほうが、かなりクリーンな音になるからです。 EQのデバイスをたくさん使って仕事量を分散させる感じですね。ひとつのEQで全部の処理をするんじゃなくて。

Jinkuは処理の負荷を分散する目的で音声信号のチェーンに複数のEQデバイスを使用している。

この曲では本物の打楽器の音を使っているんでしょうか? それともサンプルを使っていますか?

特定のアクセントを得られるようにさまざまなループをスライスして混ぜ合わせたものです。 それから、その一部をデバイスのBeat RepeatやGranulatorで処理して、オーディオにバウンスしました。

ワープ機能は必要でしたか?

実は、自分で演奏したものに対してはワープ機能を使ってません。 自分のドラムにはクオンタイズをかけないし、スイングのテンプレートも使わないですね。それだと、誰かしらのドラマーのスイングを複製するだけになりますから。 たとえば、僕らがJ Dillaのドラムを好きになる理由って、たぶん、J Dillaが自分自身のなかにあるスイング感でドラムを叩いているからです。 だから、僕もドラムの打ち込みをするときは、そのままにしておくほうが好きです。 ちょっと間違っていたら、クオンタイズをかけるよりも録り直しますね。 そのほうが、パフォーマンス性を保てますし、 コンピュータと対話しているような感じになります。自分の作るものをコンピュータに指示されるんじゃなくてね。

打楽器の箇所を作るときは、どのようにして個別の音の重なりがリズムの面と音の面で全部うまくいくようにしましたか?

では、ひとつ挙げます。つねにドラムを曲のキーにチューニングすることです。 そうすればあとは、大胆にEQをかけたりとか、パンや音量を変えたりするだけです。それと、ミキシングの作法を心がけること。 Drum Bussで全部を押しつぶすこともやりました。

チューニング用のデバイスを使ってドラムのキーを決めましたか? それとも耳で判断しましたか?

耳ですね。 曲のメロディー要素をソロにして、打楽器のクリップをひとつずつチューニングするときもありますよ。 耳でチューニングを続けていって、全部が関連していて同じ宇宙の一部だと感じられるまでやります。 全部のドラムが曲のキーになると、メロディー構造が浮かび上がってくる感じになります。

打楽器のマスターバスにかけているMax for LiveデバイスCollege Dropout(英語)は、どんな効果なんでしょうか?

基本的にはテープ・サチュレーションですね。 高音域の不快感を取り除き、低音域に丸みを持たせることができます。

Jinkuは不要な低音域と高音域を削るためにMax for LiveデバイスのCollege Dropoutを使用している。

曲全体をつうじて、ローズピアノのコードの流れからダブっぽい雰囲気が生まれています。 これはどのように処理しましたか?

このコードはArturia Analog Labの音で、そこへMaxのオーディオエフェクトColorを加えました。 Colorのフェイズ機能でコードに深みを持たせてから、ウォブル機能で音にゆらぎを加えています。 ヒスノイズが少しあるのは、パラメータ[Age]で生成しました。値の高さによってコードにビンテージな音が足されるようになっています。

JinkuはMaxのオーディオエフェクトColor を使用して、深みをはじめ、ゆらぎやヒスノイズを音に挿入している。

長めのつなぎ部分をトランペットで作っていますね。 あれは生演奏の録音ですか? それともサンプルを使ったんでしょうか?

トランペットは、Samson Maikoの演奏です。 ナイロビの地元出身の楽器奏者ですね。

この部分では、Track Stereo Pan(英語)というMax for Liveデバイスをかなり使っています。 これは何をやっているんですか

このデバイスだと、正確なステレオパンニングが可能になります。 何らかのかたちですでにパンされているサンプルを扱うときに、このデバイスを補正ツールとして使っています。 Liveの分割ステレオパンモードでオートメーションを設定する場合、左右のチャンネルを編集するのが面倒なんです。 でも、このデバイスを使えば、もっと簡単にオートメーションを設定できるようになります。 時間の節約になるし、集中力を切らさずに作業できますね。

Reverb、Spectral Blur、Delay、Grain Delayの入ったEffect Rackから、この部分の広がりと空間の多くが生まれている印象です。 このエフェクトチェーンの意図は、どんなものでしたか?

Spectral Blurに関しては、ぼかすというよりリバーブ的に使いました。 モードを[Halo]にしてパラメータの[Residual]と[Freq]と一緒に使うと、洗い流すような音になったんです。 これにドライ音を加えたら、大ホールの響きのようになりました。

Filter Delayは、空間用ですね。 ディレイをステレオ空間へさらに押し込んだんです。 このデバイスだと左右のEQを個別に設定できたので、ディレイ信号をもっと操作できました。

トランペットの一部からは、クリスタルのようなキラキラした高音が聞こえます。 これを作るために、どのデバイスを使いましたか?

キラキラした高音域をトランペットに加えたかったので、Grain Delayを使ってピッチ設定を“12”にしました。 そこの音量を小さくすると、トランペットの高音域の存在感がさらに出てきます。 ステレオ感を広げる効果もありますね。

Jinkuが使用するEffect Rackには、Reverb、Blur、Delay、Grain Delayが含まれる。空間、広がり、高域の倍音がトランペットのパートに生まれている。

アルペジオ部分のリズミカルなメロディーはどうやって作りましたか?

Arturia KeyStep Proでアルペジエーター機能を有効にして、それでArturia Analog Labを鳴らしています。 スイングと一緒に鳴らして、いろんなテイクを録音して、それをバウンスしました。 アルペジオをグリッドに合わせて演奏するんじゃなくて、アルペジオの速さに僕が乗った感じですね。 それが、何らかのかたちで打楽器っぽさを得るのに役立ちました。 両方の要素が一緒に鳴っているような感じになったんです。 Analog Labではフィルターの変更もしていて、上げ下げしながらたくさん動きを作りました。

アフリカンなボーカルはどこのものですか?

ボーカルはSplice(英語)のものです。 Spliceのおかげで音楽制作の敷居が下がったのはとってもいいことですね。 こういう音をみんなが利用できるので、抜きん出るには、独創的になる必要があります。 でも、過去にボーカリストをたくさん見つけて録音したことがありますよ。Twitterをつうじてオンラインで見つけたり、口コミをつうじてナイロビで見つけたりしました。

最近は、ボーカルなしで仕上げる曲を想像するのがすごく難しくなりました。 でも、そこから抜け出そうとしているところです。 完全にインストの音楽を作れるって自分に言い聞かせて、仕上げたぞって思うようにしています。

Liveセットのリターントラックのひとつが、“Devil Loc”となっています。 ここでは何が起こっていますか?

このリターントラックでは、EQ EightのほかにSaturatorとかDynamic Tubeとかのデバイスをたくさん使って、曲から活気を絞り出しています。 Liveセット内の全トラックをミックスバスにまとめて、このリターントラックの音を戻してミックスできるようにしました。 これには、基本的に、中音域をぬくもりのある音にする効果があります。

ミックスバスそのものには、どんなマスターエフェクトを加えましたか?

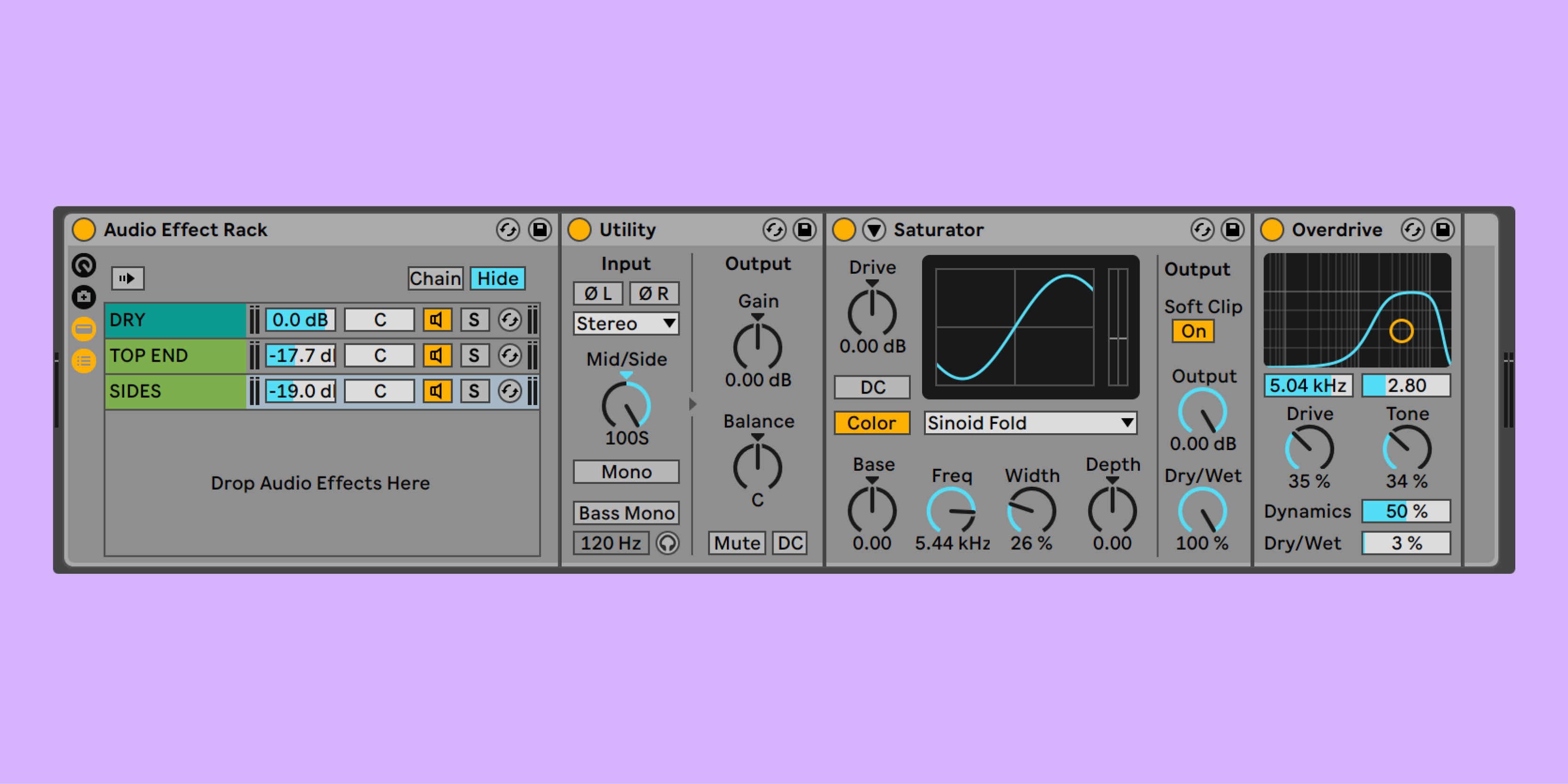

Utilityでベースをモノラルにして、EQのMS処理をしてます。 あと、“Final Glow”を使いました。これはエフェクト・ラックで、サチュレーションのほかにオーバードライブやコンプレッサーとか、いろんなものがたくさん入っています。 かなり激しいコンプレッサーみたいに動作します。 でも、マクロの設定がたったの“1”ですよね。なので、チェーン内の音声を少しくすぐっているだけです。

別のエフェクト・ラックがありますよね。そこでは、超高音域を処理して、キラキラした音になっています。 ひとつ目のチェーンをドライのままにしているので、以降のチェーンで高音域を処理しても全体の音声に影響が出ないようになっています。 そのあとは、音声を高音域だけにして、Saturatorを加えました。3つ目のチェーンでは、Utilityをミッド/サイドモードに切り替えています。 これでサチュレーションとオーバードライブを”サイド”だけにかけることができます。

Jinkuは特定の周波数帯域を処理するためにミックスバスのチャンネルで、Effect Rackを使用している。

普段、マスタリングエンジニアに曲を送るまえは、この処理をすべてそのままにしているんでしょうか?

もちろんです。見てのとおり、この曲のピーク値は-6dbですよね。 この状態で、マスタリングに出しました。

マスターエフェクトのチェーンで最初と最後にUtilityを置いているのもこのためです。 全トラックを小さい音量のままにしておけば、ゲインステージがずっと簡単になるし、すべてのプラグインを適切に増幅させて、最良で最適な鳴りにしやすくなります。 そして、最初と最後のUtilityで必要に応じて音声を削ることができます。

この曲の制作についてたくさんの見解を教えてもらい、ありがとうございました。 2022年は、どんな音楽プロジェクトを予定していますか?

こちらこそありがとうございます! そうですね。まず、今年の6月に『Passenger 555』というアルバムを出します。ケニアのKarunという歌手に参加してもらいました。 宇宙っぽい雰囲気のR&Bを7曲収録したアルバムです。 打楽器とシンセの要素がかなり強くて、一緒に極上のボーカルもあります。

7月には『Oasis Pack』っていうテープも出ます。 ナイロビからスウェーデンに移住して初めての冬を過ごすまでの道程がテーマになっています。 ケニアのアーティストとスウェーデンのミュージシャンがひとつになって、これぞ“トライバル・ダウンテンポ”な感じで融合していますよ。