Gratis-Tools erschließen 3D-Sound, VR und AR in Live

Envelop wurde als Forschungslabor für 3D-Akustik ins Leben gerufen. Nun hat das Nonprofit-Unternehmen unter der Leitung von Christopher Willits eine Reihe kostenloser Tools für 3D-Audio herausgebracht, die Sie mit Live 10 nutzen können.

Was ist 3D-Audio?

Zunächst ein Schritt zurück. Dreidimensionaler Klang ist mehr als eine bloße High-Tech-Spielerei. Es ist die natürliche Art, wie wir mit beiden Ohren hören. Wie das genau funktioniert, ist kompliziert – schon der Wikipedia-Artikel ist starker Tobak. Aber schließen Sie einmal die Augen, neigen Sie Ihren Kopf ein wenig zur Seite und lauschen Sie den Geräuschen um sich herum. Alles ist räumlich.

Genauso wie der Schritt von Mono zu Stereo beeinflusst das Abmischen in 3D musikalische Entscheidungen. Es sorgt für Transparenz, es eröffnet neue Zusammenhänge zwischen den Klangelementen und erhöht dadurch ihre Wirkung.

Es scheint also, als wäre die Zeit reif, Klänge und Musik dreidimensional aufzufassen, sowohl in der persönlichen Erfahrung als auch im Konzertsaal. Intuitiv leuchtet 3D-Sound sogar noch eher ein als sein visuelles Gegenstück. Man muss keine merkwürdigen Dinge auf den Kopf setzen und verwirrende Sinnesreize ertragen oder sich auf die Illusionen der Stereoskopie aus dem 19. Jahrhundert verlassen. Da Klang an sich bereits ebenso flüchtig wie Luft ist gilt dasselbe auch für räumlichen Klang.

Was hält uns eigentlich noch zurück? Bereits für Stereo war das Zusammenspiel mehrerer Geräte notwendig, vom Einspeisen eines solchen Signals bis zum Lautsprecher. Die Implementierung solcher Signalwege für 3D entwickelt sich rasch – und das nicht nur in Sachen Herstellerstandards fürs Kino.

Der Siegeszug von Stereo setzte noch etwas anderes voraus, nämlich Mischpulte mit Panning-Reglern. Stereo trat also nur auf, weil bestimmte Tools für Produzenten verfügbar waren.

Auf den ersten Blick auf Envelops neue Tools für Live 10 fallen so etwas Ähnliches wie Panning-Regler ins Auge. Schon mithilfe einiger weniger Gratis-Tools können Sie mit dem Raum experimentieren, die Ergebnisse über Kopfhörer nachvollziehen oder Ihr Set für beliebig viele Lautsprecher ausbauen. Sogar in eine der zahlreichen Standardumgebungen für Virtual-Reality, 3D, Games und immersive Installationen können Sie Ihre Sounds einspeisen.

Die vielen Möglichkeiten könnten den Durchbruch für das Abmischen in 3D bedeuten. (Und vielleicht erzielen Sie dadurch sogar einige Durchbrüche für sich selbst.)

Envelops Tools in Live

Envelop for Live (E4L) ist auf GitHub vertreten. Das Toolset ist nicht komplett gratis – für die Vollversion benötigen Sie Live Suite. Sie brauchen Live 10, da es im Hintergrund das erforderliche mehrfache Audio-Routing bereitstellt. Unter diesen Voraussetzungen stehen Ihnen eine Reihe Max-for-Live-fähiger Anwendungen zur Verfügung, womit Sie Studioproduktionen und Performances mit 3D-Sound gestalten können. Entwickler erhalten zudem ein Toolset in die Hand, um eigene Effekte zu programmieren.

Starten Sie hier mit dem Download: http://www.envelop.us/software/

Auf der Entwickler-Seite erfahren Sie Einzelheiten: https://github.com/EnvelopSound/EnvelopForLive/

Lesen Sie eine Zusammenfassung über das System und einige grundlegende Erklärungen zur Funktionsweise (mit Erklärungen der Fachtermini für 3D-Sound):

https://github.com/EnvelopSound/EnvelopForLive/wiki/System-Overview

Lesen Sie außerdem auf dem Wiki die Anleitung für Erste Schritte, Routing, Toolbeschreibungen und weiteres Zusatzmaterial:

https://github.com/EnvelopSound/EnvelopForLive/wiki

Diese Software ist wundervoll und elegant– die freundlichste, die ich bisher zum Thema 3D-Audio kennengelernt habe. Hut ab vor den Programmierern an vorderster Front: Mark Slee, Roddy Lindsay und Rama Gotfried.

Auf dieser Idee beruht das gesamte Paket:

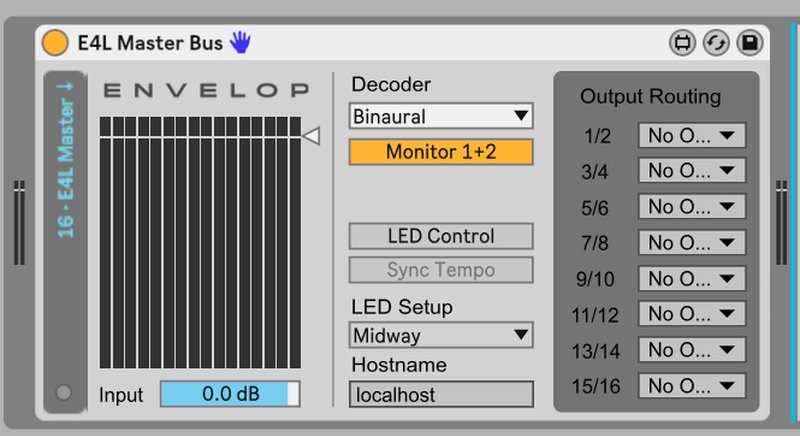

Output. Der Master Bus bezieht sich auf Ihre Ausgänge. Er dekodiert die räumlichen Informationen in Ihrem Sound und passt das Routing an, je nach dem, wie viele Lautsprecher angeschlossen sind – ob es sich dabei nun um Ihre Kopfhörer handelt, vier Lautsprecher oder ein riesiges Lautsprecher-Array. (Das ist der Vorteil eines skalierbaren Systems, später mehr dazu.)

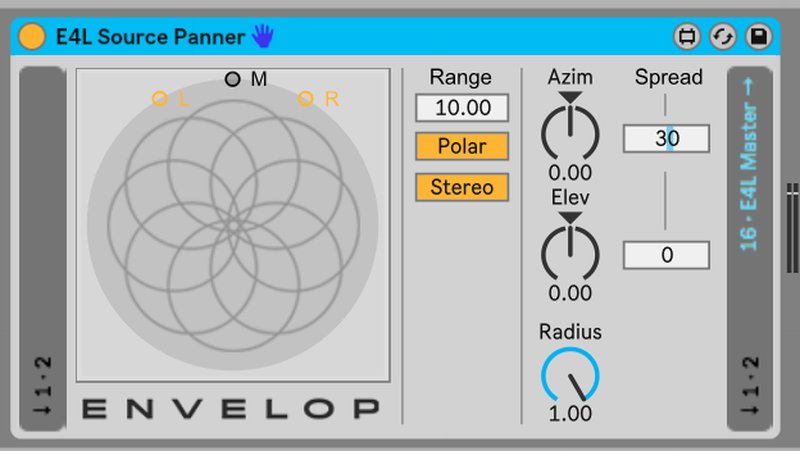

Sources. Der Mixer von Live 10 mag zwar eher darauf ausgelegt sein, Tracks in Stereo abzumischen. Aber Sie können ihn sich ebensogut als ein Sammelbecken für unterschiedliche Signalquellen vorstellen. Ziehen Sie den Source Panner in eine Spur hinein, können Sie die jeweiligen Sounds im dreidimensionalen Raum anordnen.

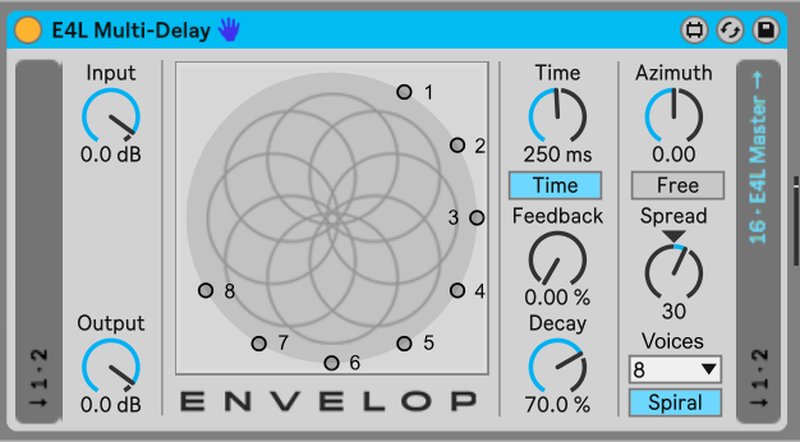

Processors. Ein anständiges 3D-System ermöglicht nicht nur die Positionierung im Raum, sondern verfügt auch über eigene Effekte und Tools, denn gewöhnliche Delays, Reverbs und dergleichen gehen von einem Links-rechts- oder Mitte-Seite-Stereooutput aus. (Die immersive Wirkung entsteht unter anderem dadurch, dass man nicht nur die Position der Klangquellen hört, sondern die Reflexionen um sie herum.)

In diesem Downloadpaket erhalten Sie:

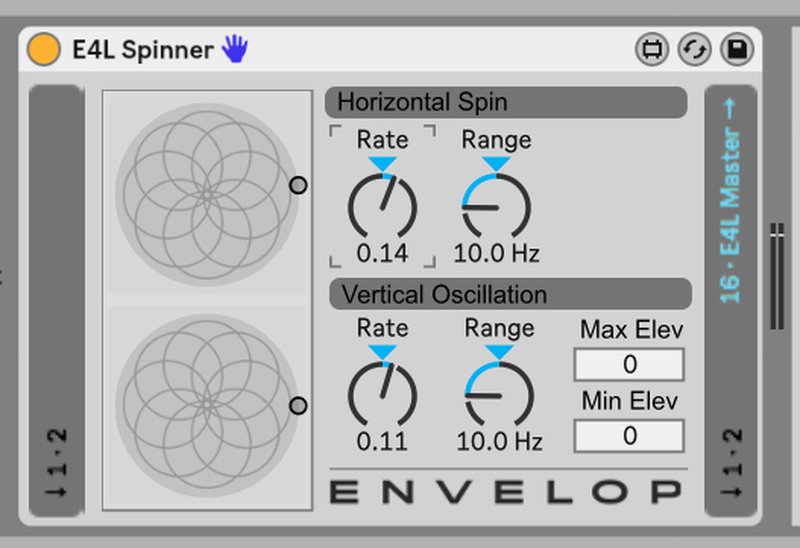

Spinner: automatisiert horizontale Bewegungen und vertikale Oszillationen im Raum

B-Format Sampler: spielt vorhandene Ambisonics-Dateien ab, d.h. Samples mit bereits enkodierter räumlicher Information.

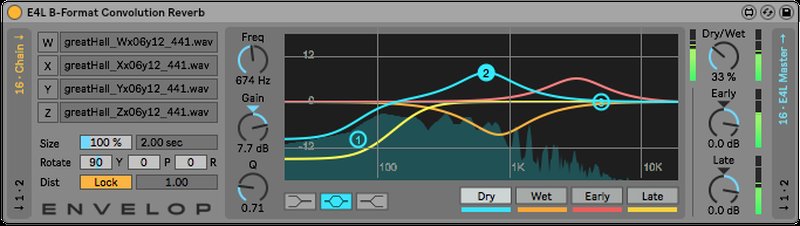

B-Format Convolution Reverb: Faltungshall, der dreidimensionale Informationen verarbeitet

Multi-Delay: kaskadierende, dreidimensionale Delays für Mono-Quellen.

HOA Transform: formt und modelliert in Echtzeit ein räumliches Klangfeld (basiert auf Ambisonics)

Meter: Anzeige für die räumliche Anordnung. Cool.

Spinner – zum Automatisieren von Bewegung

Dreidimensionales Multi-Delay

Convolution-Reverb im Stil von Ambisonics

Alle räumlichen Informationen werden mithilfe einer Technik namens Ambisonics abgebildet. Im Prinzip wendet jedes raumbezogene System, sogar Stereo, Mathematik an, um die relative Amplitude und den zeitlichen Verlauf eines Signals zu bestimmen und dadurch einen bestimmten Raum- bzw. Tiefeneindruck herzustellen. Ambisonics unterscheidet sich jedoch dahingehend, dass es das räumliche Feld abbildet, d.h. den Wirkungsbereich der Klangquellen bezogen auf den Hörer (unabhängig von den konkreten Lautsprechern). Stellen Sie sich also vor, wie Sie Ihre Signale in einem perfekten virtuellen Raum platzieren und das Ergebnis dann auf die jeweils verfügbaren Lautsprecher übertragen.

Eine solche Skalierbarkeit ist ganz zentral. Einfach mal alles mit Kopfhörern nachvollziehen? Schalten Sie beim Master auf „binaural“ und Sie erhalten eine angenäherte Darstellung in Stereo. Oder stellen Sie vier Lautsprecher im Studio auf – oder acht. Oder schließen Sie Ihren Sound an ein großes Lautsprecherarray in einem Planetarium oder in einem Kino an. Sie brauchen nur die Outputs zu routen und die Software passt die Dekodierung dementsprechend an.

Envelop ist bei weitem nicht das erste Toolset, das Ihnen hierbei behilflich ist. Die Technologie reicht bis in die 70er Jahre zurück und über die Jahre wurden verschiedene, oftmals kostenlose Software-Implementierungen entwickelt. Aber Envelop lässt sich besonders mühelos in Ableton Live nutzen.

Open Source und Standards

Hervorzuheben ist, dass Envelop kostenlos als Open-Source-Software verfügbar ist. Max/MSP, Max for Live und Ableton Live sind bekanntermaßen proprietäre Anwendungen, aber bei Envelop existieren die Patches und Erweiterungen davon unabhängig. Die Open-Source-Lizenz bedeutet, dass Sie den Code und die Patches zum Lernen nutzen und auch modifizieren können. Noch dazu können Sie Ihre Projekte mit anderen Usern und Geräten teilen, vorausgesetzt, alle haben Live 10 Suite.

Die zugrunde liegende Technologie ist hier komplett offen und standardisiert. Ambisonics funktioniert in zahlreichen unterschiedlichen Anwendungsbereichen für 3D, von intimen VRs bis hin zu riesigen Live-Performances. Per Definition ist der Klangraum von Ambisonics an keine bestimmte Lautsprecheraufstellung gebunden, ist also von Haus aus flexibel. Wenn Sie also 3D-Sound wie eine Art Instrument erlernen, brauchen Sie nicht jedes neue System als ein neues Instrument zu betrachten oder Ihren Mix anzupassen, wenn Sie auf ein anderes Lautsprecher-Setup umsatteln.

Die Grundlagen, auf denen das Envelop-Team aufgebaut hat, sind erfahrenen Max/MSP-Usern wahrscheinlich vertraut. Sie sind das Werk des Institute for Computer Music and Sound Technology an der Zürcher Hochschule der Künste. Das ICST hat mehrere Open-Source-Externals für Max/MSP entwickelt:

https://www.zhdk.ch/downloads-ambisonics-externals-for-maxmsp-5381

Veranstaltungsorte, VR, AR und Ausblicke

Damit der Vorteil von 3D-Sound zur Geltung kommt, brauchen Sie als Musiker oder Musikerin überzeugende Veranstaltungsorte – und das Envelop-Team baut diese selbst. In San Francisco ist Envelop SF ein fester Veranstaltungsort, der sich 3D-Sound und -Forschung verschrieben hat. Envelop Satellite ist das mobile Gegenstück dazu, das beispielsweise zu Festivals reisen kann. Da Envelop SF und Envelop Satellite auch über LED-Effekte verfügen, finden Sie in E4L einige Templates zum Steuern von Licht, die womöglich auch für Ihre eigenen Ideen nützlich sind.

Über die Veranstaltungsorte hinaus wächst auch das Netz von Produkten zur Erzeugung und Aufführung, eines das Konzertorte genauso wie intime immersive Medienkunst umspannt. Oder einfacher gesagt, nachdem Aufnahmegeräte und Studiotechnik ein gutes Jahrhundert lang Mono oder Stereo voraussetzten, passen sie sich nun an jene Dreidimensionalität an, die Ihre Augen und Ohren schon immer wahrnehmen konnten. Und Sie können sich an den Ergebnissen freuen, ob Sie nun mit einem Headset auf Ihrem Sofa sitzen oder lieber zu einer Live-Veranstaltung gehen.

Zu den Ambisonics-fähigen Produkten für Virtual- und Augmented-Reality zählen inzwischen u.a. Facebook 360, Google VR, Waves, GoPro – und es kommen weitere dazu. Sie können mit Live 10 und Envelop for Live Ihre Musik und Ihre Sounds also auch für diese Umgebungen entwickeln.

Text: Peter Kirn

In der englischen Langfassung erschien dieser Artikel zuerst auf Create Digital Music.